blog

AIブログ

Transformerとは?AI自然言語学習の技術を解説

「TransformerってChatGPTと関係あるの?」

「Attention Is All You Needって何?」

結論から言うと、Transformerとは「AIが文章・画像・音声を理解するための革命的な仕組み」であり、ChatGPT・Claude・Geminiなど現代の生成AIのほぼすべての基盤技術です。

この記事ではAI開発に携わるクリスタルメソッドが、Transformerの仕組み・特徴・ChatGPTとの関係・発展モデルまで、数式なしでわかりやすく解説します。

Transformerとは?

Transformer(トランスフォーマー)とは、2017年にGoogleの研究者らが発表した論文「Attention Is All You Need」で登場した深層学習モデルのアーキテクチャ(設計構造)です。

それまでの主流だったRNN(リカレントニューラルネットワーク)に比べて、

- 学習速度が大幅に速い

- 長い文章でも文脈を正確に理解できる

- 並列処理が可能でスケールしやすい

という革命的な特性を持ちます。

ChatGPTの「GPT」はGenerative Pre-trained Transformerの略です。つまりChatGPTの名前にTransformerが入っているほど、現代のAIにとって中心的な技術です。

ChatGPT・Claude・GeminiとTransformerの関係

現代の主要な生成AIは、ほぼすべてTransformerをベースにしています。

| AI名 | 開発元 | Transformerとの関係 |

|---|---|---|

| ChatGPT(GPT-4o) | OpenAI | GPT=Generative Pre-trained Transformer。名前にTransformerが含まれる |

| Claude | Anthropic | TransformerベースのLLM。Constitutional AIで安全性を強化 |

| Gemini | TransformerベースのマルチモーダルAI | |

| BERT | Transformerのエンコーダ部分を活用した言語理解モデル | |

| Stable Diffusion | Stability AI | 画像生成にTransformerの変形版を活用 |

私たちクリスタルメソッドが開発するAIアバターの「自然な会話生成」にも、TransformerベースのLLMを活用しています。TransformerなしにはAIが「文脈を読んだ自然な応答」をすることはできません。

Transformerが登場する前の問題

Transformerの革新性を理解するには、それ以前の技術の限界を知る必要があります。

RNN(リカレントニューラルネットワーク)の限界

Transformer登場以前、自然言語処理の主流はRNNでした。RNNは文章を「単語を1つずつ順番に処理する」仕組みです。

たとえば「私はずっと前から東京に住んでいて、昨日そこで面白い人に会った」という文章で、「そこ」が「東京」を指すことを理解するには、文章の最初の方まで記憶をたどる必要があります。

RNNの問題点は2つです。

- 長期記憶が苦手:文章が長くなると最初の方の情報を「忘れる」

- 並列処理ができない:単語を順番に処理するため学習が遅い

Transformerはこの2つの問題を一気に解決しました。

Transformerの仕組み:「Attention」がすべてのカギ

Transformerの核心は「Attention(アテンション)機構」です。

Attentionとは何か

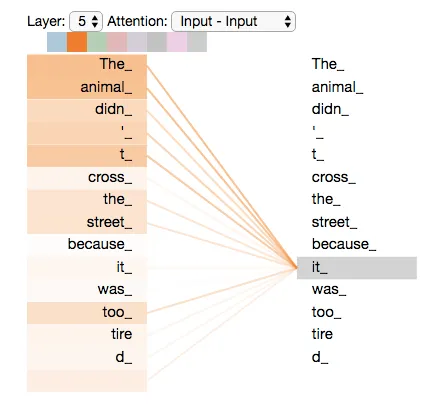

Attentionとは、文章中の「どの単語がどの単語と関係が深いか」を計算する仕組みです。

たとえば「The cat sat on the mat because it was tired」という文で、「it」が何を指すか(the catを指す)を理解するには、文中の他の単語との関係性を計算する必要があります。Attentionはこれを数値として表現します。

重要なのは、RNNのように順番に処理するのではなく、文章の全単語を同時に見て関係性を計算できる点です。これが並列処理を可能にし、学習速度を劇的に上げた理由です。

Self-Attention(自己注意機構)

Transformerが使うのは「Self-Attention」と呼ばれる仕組みです。1つの文章の中で単語同士がどう関係しているかを、外部情報なしに文章内部だけで計算します。

例として「I like baseball」の場合、

- 「I」は「I」自身との関連度が最も高い(0.85)

- 「I」と「like」の関連度は低め(0.05)

- 「I」と「baseball」の関連度も低め(0.10)

というスコアを計算し、それをもとに各単語の意味をより正確に表現します。

Multi-Head Attention

http://jalammar.github.io/illustrated-transformer/ より引用

Transformerはこの Self-Attentionを複数並列で同時に実行(Multi-Head)します。

1つのAttentionでは「文法的な関係」を捉え、別のAttentionでは「意味的な関係」を捉える、というように複数の視点から同時に文章を解析することで、より豊かな言語理解が可能になります。

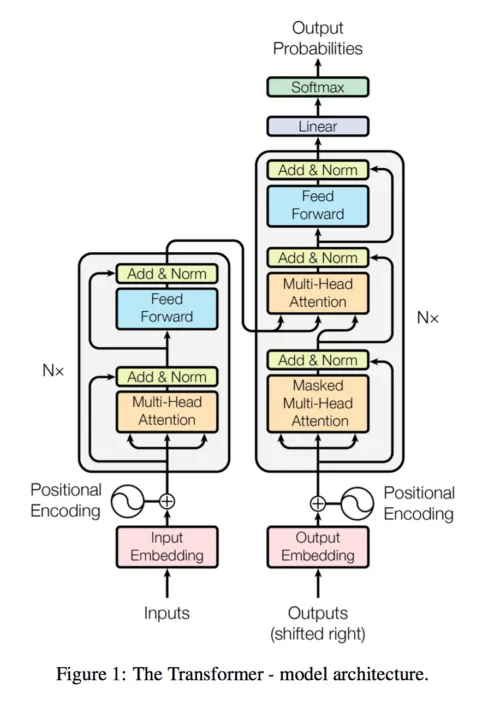

エンコーダとデコーダ

Transformerは大きく2つの部分から構成されます。

- エンコーダ:入力文章を分析して意味を抽出する。「読む」役割

- デコーダ:エンコーダの出力をもとに新しい文章を生成する。「書く」役割

翻訳タスクなら「英語の文章をエンコーダが分析→デコーダが日本語に変換」という流れです。なお、ChatGPTはデコーダ部分のみを使った「デコーダのみ型」のアーキテクチャです。

TransformerがChatGPTになるまでの流れ

2017年のTransformer登場から、ChatGPTが誕生するまでの主なステップを整理します。

2017年|Transformer登場

Google研究者らが「Attention Is All You Need」を発表。機械翻訳で従来モデルを大幅に上回る性能を実証。

2018年|BERT登場(Google)

Transformerのエンコーダを使った言語理解モデル。文章の穴埋め・文脈理解で革命的な精度を達成。Googleの検索エンジンに採用され、日本語を含む70以上の言語に対応。

2018年|GPT-1登場(OpenAI)

Transformerのデコーダを使ったテキスト生成モデル。大量のテキストで事前学習(Pre-training)するアプローチを確立。

2020年|GPT-3登場

1,750億パラメータの超大規模モデル。人間が書いたような自然な文章を生成できることで世界に衝撃を与えた。

2022年|ChatGPT登場

GPT-3.5ベースに強化学習(RLHF)で会話に最適化。公開2ヶ月で1億ユーザー達成。生成AIブームの起点となった。

2023〜2026年|GPT-4・Claude 3・Gemini 1.5

マルチモーダル(テキスト+画像)対応・長文処理・推論能力の大幅向上。専門家レベルの試験に合格するモデルが続出。

マルチモーダル対応の流れは、対話AI領域だけでなく、見た目を伴う応用にも広がっています。たとえばAIアバターのビジネス活用は、Transformerベースの対話モデルに、表情・音声合成・身

体動作を統合したマルチモーダル実装の代表例です。

Transformerの発展モデル

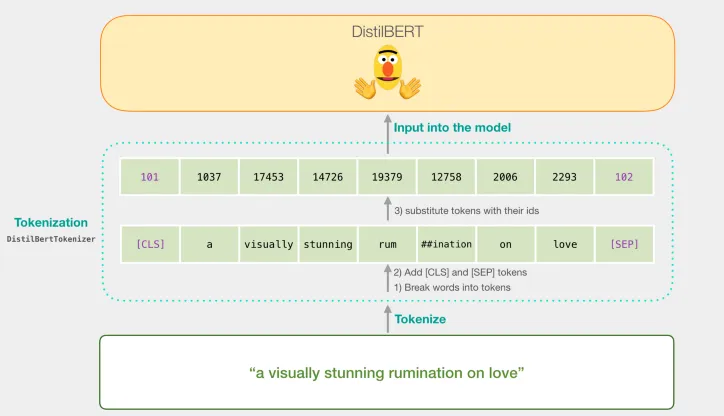

BERT(Bidirectional Encoder Representations from Transformers)

Deep Transformer Models for Time Series Forecasting: The Influenza Prevalence Case より引用

Googleが2018年に発表。Transformerのエンコーダを双方向(前後両方向)に使うことで文脈理解を強化。Googleの検索エンジンに採用されており、私たちが日々使う検索結果に直接影響しています。

GPT(Generative Pre-trained Transformer)シリーズ

OpenAIが開発するデコーダ型モデル。GPT-1からGPT-4oまで進化を続け、ChatGPTの基盤となっています。

こうした対話モデルの応用領域として、採用面接の自動化があります。AI面接の評価アルゴリズムでは、TransformerベースのLLMが候補者の

回答を解析し、コンピテンシー適合度を根拠付きでスコア化する仕組みになっています。

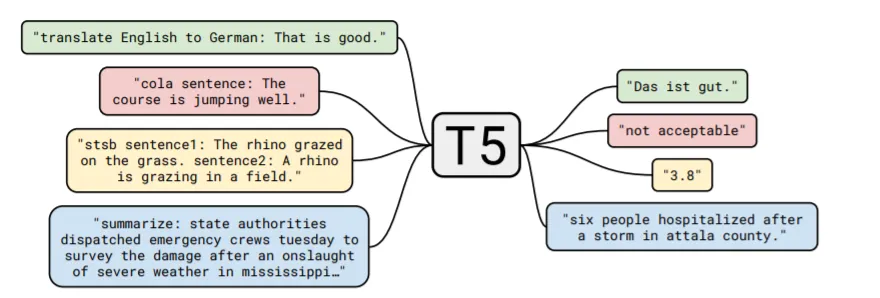

T5(Text-to-Text Transfer Transformer)

論文(Exploring the Limits of Transfer Learning with a Unified Text-to-Text Transformer)より引用

Googleが2020年発表。あらゆるNLPタスクを「テキスト→テキスト変換」として統一的に扱うことで、翻訳・要約・Q&Aなど多様なタスクを1つのモデルで解決できます。

Reformer

論文(REFORMER: THE EFFICIENT TRANSFORMER)から引用

TransformerのAttention計算を効率化し、長い文章でも軽量に処理できるよう改良したモデルです。

Vision Transformer(ViT)

テキスト用だったTransformerを画像認識に応用したモデルです。2020年に発表され、画像AIの分野でも主流技術になりつつあります。

テキスト・画像・音声を統合的に扱うマルチモーダル化は、感情の推定領域とも相性が良く、感情認識AIの仕組みでもTransformerベースの統合解析が中核技術として

使われています。

Transformerの実装フレームワーク

実際にTransformerを使って開発・研究をしたい場合、以下のツールが広く使われています。

Hugging Face Transformers

Hugging Face社が提供するオープンソースライブラリです。BERT・GPT・T5など数千のTransformerモデルを数行のコードで使えます。AI開発者の間では事実上の標準ツールです。

PyTorch・TensorFlow

Transformerをゼロからまたはカスタムしてビルドするためのディープラーニングフレームワークです。研究・開発の現場で最も広く使われています。

よくある質問(FAQ)

Q. TransformerとLLMの違いは何ですか?

TransformerはAIの「設計構造(アーキテクチャ)」であり、LLM(大規模言語モデル)はTransformerを使って大量のデータで学習した「モデル」です。TransformerはLLMを作るための「器」、LLMはその器に膨大なデータで学習した「中身」と言えます。

Q. TransformerはテキストだけでなくChatGPTの画像認識にも使われていますか?

はい。GPT-4oやGeminiなどのマルチモーダルAIは、テキストだけでなく画像もTransformerで処理しています。Vision Transformer(ViT)の登場以降、画像・音声・動画とTransformerの応用範囲が急拡大しています。

Q. 「Attention Is All You Need」とはどういう意味ですか?

2017年のGoogledの論文タイトルです。「Attentionだけで(RNNやCNNなしで)十分な性能が出せる」という主張を表しています。この論文でTransformerが発表され、現代のAI革命の起点となりました。

Q. TransformerはRNNより常に優れていますか?

ほとんどのNLPタスクではTransformerが優れていますが、リソースが限られた組み込み環境・リアルタイム処理では軽量なRNNやLSTMが使われるケースもあります。用途によって使い分けが行われています。

Q. Transformerを学ぶにはどこから始めればいいですか?

Hugging FaceのTransformersライブラリのチュートリアルから始めるのが最短ルートです。コードを書かずに仕組みを理解したい場合は「The Illustrated Transformer(Jay Alammar氏のブログ)」が図解で非常にわかりやすく解説しています。

まとめ

- TransformerとはAIが文章・画像・音声を理解するための深層学習アーキテクチャ

- 2017年のGoogle論文「Attention Is All You Need」で登場

- 核心技術は「Attention機構」。文章中の単語の関係を並列に計算する

- RNNの「長期記憶が苦手・並列処理できない」という弱点を解決した

- ChatGPT・Claude・Gemini・BERTなど現代の主要AI全般の基盤技術

- テキストから画像・音声・動画へと応用範囲が急拡大している

- Hugging Face Transformersで実際に試すことができる

関連記事

DXとは(デジタルトランスフォーメーション)?定義や意味を解説!

https://crystal-method.com/topics/dx

Study about AI

AIについて学ぶ

-

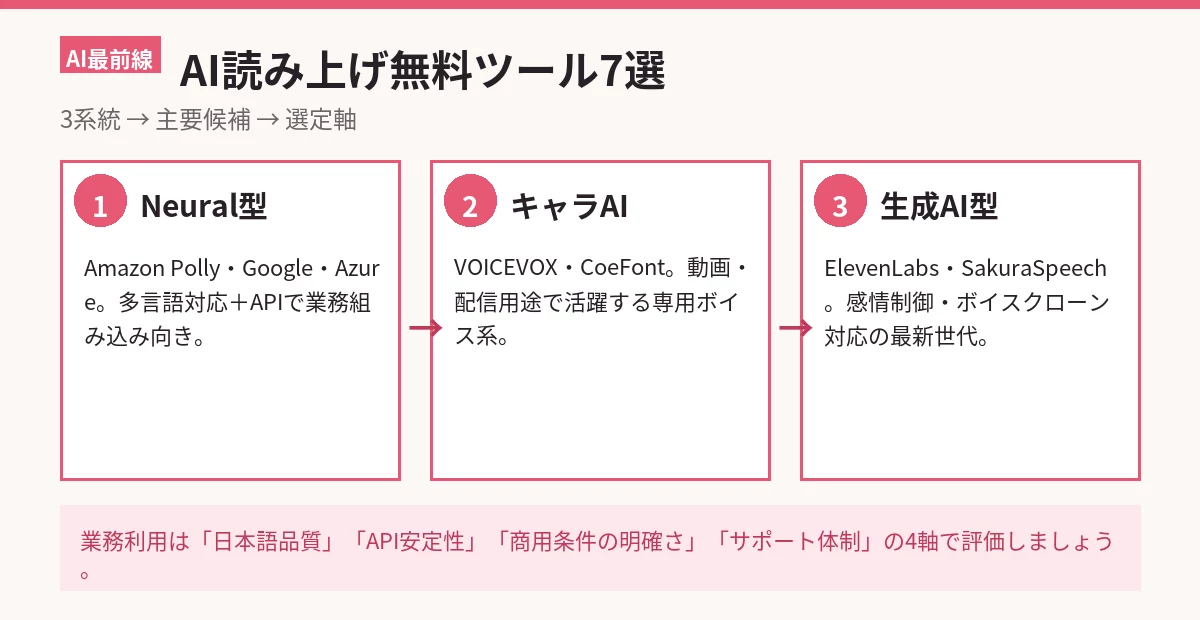

AI読み上げ無料ツール7選|自然な声の選び方と活用術【2026】

AI読み上げ無料ツールを選ぶときは「自然さ」「商用利用可否」「日本語品質」「API有無」の4軸で評価するのが、用途を問わず外さない選定基準です。本記事では、現役...

-

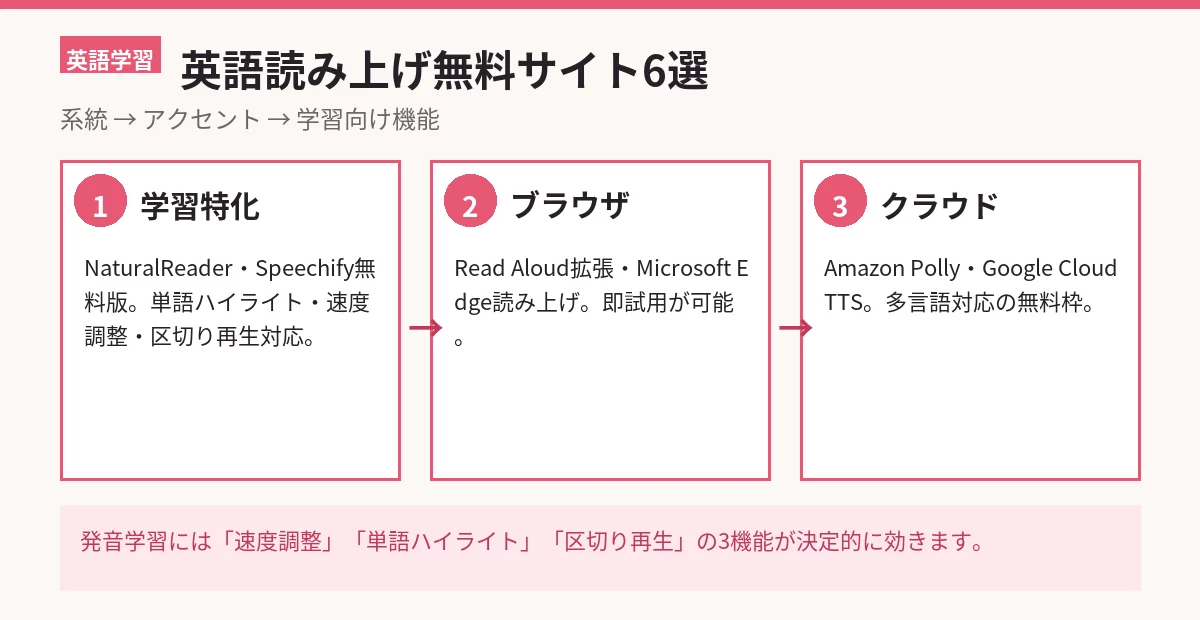

英語読み上げ無料サイト6選|発音学習に使える厳選ツール

英語の読み上げ無料サイトを選ぶときは「アクセント切替」「速度調整」「単語ハイライト」の3機能を備えたものを優先するのが、発音学習に最も効きます。本記事では、現役...

-

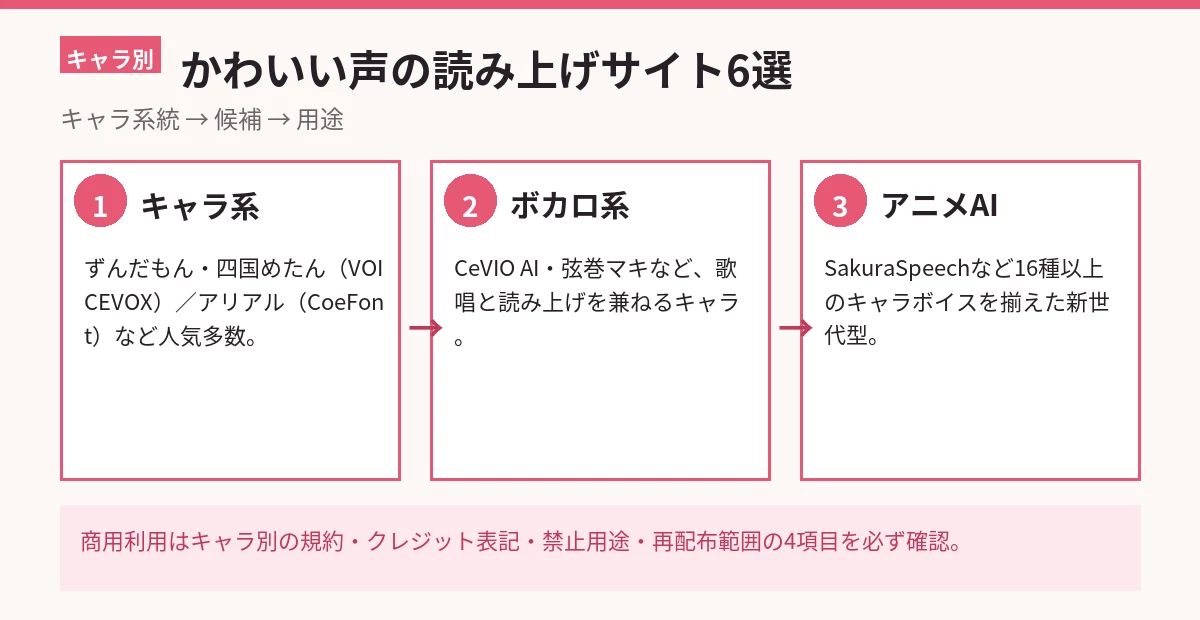

かわいい声の読み上げサイト6選|キャラ別比較ガイド【2026】

かわいい声の読み上げサイトを選ぶときは「キャラ系統」「商用利用条件」「声質の個性」の3軸で絞り込むのが正解です。本記事では、現役のAI音声合成エンジン開発者の目...