blog

AIブログ

音声認識とは?仕組みとクリスタルメソッドでの取り組みを解説!

音声認識という言葉をご存じでしょうか?

近年、テクノロジーの向上により人間と機械が会話する仕組みが開発されたり、文字を入力すれば機会が代わりに話してくれるソフトなどが開発されてきました。これらは音声認識という技術が確立されたことで出来たことなのですが、その仕組みや開発の過程を詳しく知っている方は少ないのではないでしょうか?

普段何気なく使っているものに音声認識が使われていたり、音声認識に関する新たな発見、弊社の音声認識に対する取り組みなどについて、AIの受託開発業務を専門におこなう弊社の目線で解説していきますので参考になれば幸いです。

音声認識とは?

音声認識とは、コンピュータが人間の発言した音声データをテキストに変換する技術のことをいいます。

この部分だけを聞くと一見簡単なように聞こえますが、実はかなり複雑な要素が絡み合っています。特に、日本語は独自の構文や言い回しの表現、方言によって同じ言葉でも全く違う発音だったりと、他の言語に比べて複雑で実現が難しいとされていました。

しかし、AIの進化に伴い音声認識の技術が劇的に向上し、今やスマートフォンなどにも使われるほど一般的に普及している技術です。

音声認識の歴史

今や「Amazon Echo」やGoogleのホームアプリにも標準搭載されている人の質問に応えてくれたり、適切なアプリを起動してくれる機能ですが、これらは音声認識の技術が使われています。文字を入力する手間が省けたり、声のみでハンズフリーで操作できたりと便利な機能ですが、実現に至るまでに様々な研究がなされていました。

音声認識の土台となったのは1950年代のアメリカです。声を出すための人間の声帯や喉の構造を研究した結果、声を数式モデルで再現することが可能だとわかりました。声を再現した数式モデルと同じ音を出せば声と同様の音が出せるのではと考え、その構造を再現する機構を開発しました。実際に1960年代には、アメリカが人間の声を認識して文字に変換する世界初の音声認識計算機「Shoebox」を開発し、日本の京都大学も音声を認識して文字に変える、音声タイプライターの開発に成功しています。

しかし、ひらがな一文字ずつの認識はできても単語ごとの認識や、その人の話し方や滑舌、訛りなどの認識はできませんでした。そのため、文字が意味なく並んでいるだけの状態であるため、機会は人間の言葉の内容を理解することができず、実生活で使えるレベルではありませんでした。

そこへ画期的な製品が開発されました。それがMicrosoft社が開発したWindows95に搭載された「スピーチツール」です。精度自体は高くないものの、従来のテキストを打ち込むだけの音声認識から一定の技術の向上が見て取れました。音声を認識するカーナビゲーションシステムが登場したのもこの時期になります。

少しずつ機械が人間の声を認識し始めたのです。

音声認識の転換点

現在はSiriやスマートスピーカーに代表されるように、人間の声を当たり前のように認識していますが、この技術はAIとの関係性を無しに語れません。音声を認識する技術も、その音声に対する返答する技術も、AIの強化学習で精度が各段に向上しました。

音声認識の技術自体は1990年代から研究されていました。最初の関門となったのが「音」と「声」をどう区別するのか、という点でした。

人間には雑音と人の声を簡単に区別することができますが、コンピュータにはどの音も同じ音としか認識することができませんでした。また、曲のように人の声と楽器の音が混ざっているような場合も聞き分けることが難しく苦手としていました。さらに、「いこう」という言葉を認識できたとしても「行こう」なのか、「以降」なのか、「移行」なのか、言葉の意味を理解させる必要もあり、難易度は相当高いものでした。

これらの問題を解決したのがAIの強化学習です。強化学習によって、言葉の認識や意味をその都度覚えさせ、徐々に知識を蓄積させることで、その前後の言葉や文脈によって適切な言葉を選択できるようにし、精度を高めていったのです。

音声認識の仕組み

音声認識には様々な工程が含まれています。

人間であれば、音を空気の振動として耳でキャッチし、振動を電気信号に変換します。この電気信号は脳に伝わり音として認識され、どんな音なのか、どんな言葉なのかを理解しています。

これに対し、コンピュータは全く違うプロセスを経ています。

①音響分析

②音響モデル

③パターンマッチ

④言語モデル

⑤辞書方式

これら5つの工程で音を声として認識し、テキストとして出力します。

次項では、それぞれのプロセスでAIが音をどのように処理しているのかをわかりやすく解説していきます。

音響分析

まず、録音された音声の特徴を解析し、周波数や音の強弱を抽出し、音声データに変換する作業から始めます。

その際に、音声データから余計な雑音を取り除く必要があります。前述したように、人間の耳は会話中は相手の声に集中することができ、周りの雑音や騒音と区別することができます。しかし、AIは全ての音を同一に捉えてしまうため、一度人の音声とそれ以外の雑音や集音時のノイズを除去させます。

これらの作業をまとめて音響分析といいます。

音響モデル

データに変換した音声を過去の強化学習のデータと照合し、音波の最小単位である音素を抽出する作業を音響モデルといいます。音素とは、音声を発生したときに確認できる音波の最小構成要素です。

そもそも日本語は、

「母音(あいうえお)、子音(23種類)、擬音(ン)」

の組み合わせで構成されています。(英語の場合は、分解するとアルファベット26文字の組み合わせとなります。)

そして、「こんにちは」を「ko-n-ni-chi-ha」と変換するように、日本語をローマ字に当てはめて分解したものが音素となります。

しかし、この段階ではどの音素で構成されているかがわかっただけですので、ここからさらに細かい音声認識をしていきます。

パターンマッチ

上記のプロセスでは音声データから音素を抽出し、ただの音素の文字列に一旦分解しました。次は音素がどの言葉に当てはまるのかを探していきます。これをパターンマッチといいます。

上記の「ko-n-ni-chi-ha」という音素の羅列がどの言葉に該当するのか、辞書を引いて「ko」の項目から探す作業をイメージするとわかりやすいかと思います。実際にAIも「発音辞書」と呼ばれるデータベースから同じ文字の羅列を探し出し、照合することで「ko-n-ni-chi-ha」を「こんにちは」と初めて認識できるようになります。

しかし、認識する段階で誤ったものを探し出す場合もあります。その場合は人間の手で修正し、機械学習としてAIに覚えさせていきます。

言語モデル

③のパターンマッチだけでは、単語ごとでしか認識できていません。人間の会話は前後の文字や文脈など、様々な要素が関わっていますので、ここからより日本語の文章に近づける作業が必要になります。これを言語モデルといいます。

それぞれの音素を抽出したのちに、それぞれを再度単語として認識し、その単語同士を繋げて違和感のない日本語の文章になるようにします。その違和感のない文章の参考として使われているのが「N-garmモデル」です。

「N-garmモデル」とは、クロード・エルウッド・シャノンが考案した言語モデルで、特定の文字が出てきたときに、次にどの言葉が出てくる可能性が高いのかを調査したモデルです。「こんにちは」という文字を認識した際に、次は「いい天気ですね」や「お元気ですか?」という言葉が続く可能性が何%か?という膨大なデータが入っており、その統計に基づいて次の言葉を予想しながら単語を繋げ、日本語の文章として違和感がないように整合していきます。

あくまで過去の強化学習のデータによる確率の話になりますので、誤っている場合はその都度修正して学習させ、精度をあげていきます。人間の言葉には、単語だけでなく、接続詞や枕詞、「えーっと」のような間投詞など、複雑なものがたくさんあります。それらを大量に音声データのサンプルとして収集し、AIに強化学習で認識させ、過去のデータと照合して頻出度の高いものを予測して出力しているのが音声認識になります。

音声認識の工程の簡単な例

例:「こんにちは、今日は暑いですね。」

①音声データから人の声のみを抽出する(音響分析)

②「ko-n-ni-chi-ha-kyo-u-ha-a-tu-i-de-su-ne」という音素に分解(音響モデル)

③「ko-n-ni-chi-ha」→[こんにちは]、[婚日][は]、……のように発音辞書から該当するものを探し当て、単語ごとに当てはめていく(パターンマッチ)

④言語モデルの過去のデータと照らし合わせ、正しい文章になるように整合していく(言語モデル)

○[こんにちは][今日][は][暑い][です][ね]

×[こんにち][は][京は][熱い][です][ね]

話す相手やその場の状況、外的要因などを考慮して、耳から入った相手の音声を一瞬で解析する人間の脳と比べると、音声認識は様々な工程を経て解析していることがわかります。

「音素に分解」→「当てはまる単語に再構築」→「文章として違和感がないように整える」のような作業はコンピュータの高性能化、AIの強化学習の発達により、高精度で瞬時に解析することが可能になりました。現在は、スマートフォンやAIスピーカーなどに導入されています。

弊社の機能について

雑音抑制

雑音抑制とは、AIが人の言葉と周りの雑音とを判別する機能応用したものです。

この技術は、耳が遠い方に必要な音のみを拾い上げ伝える補聴器に使用されています。旧式の補聴器は、とにかく音を拾い集めて鼓膜に届けるものでしたが、雑音や騒音も拾ってしまうために、却って耳が痛くなってしまったり、肝心の声が聞こえにくいといった欠点がありました。

より快適な補聴器の研究を進めた結果、音響分析を用いて人の声や騒音・雑音の周波数を強化学習で覚えさせていきます。必要な声の音声はそのままに、不要な音だけを抑えることでスムーズに聞き取りができるようになりました。また、強化学習で日本語に特化することで方言や訛りにも対応でき、ご年配の方でも聞き取りやすくしています。

雑音抑制はイヤホンにも使用されています。音声対話機能でハンズフリーに対応できるように、イヤホンも様々なメーカーが注目しています。若者のおしゃれアイテムになっているイヤホンやヘッドフォンに導入して、通話中の音声を聞き取りやすくしたり、ストレス軽減にも一役買っています。音への品質をこだわる企業も増え、いい音を聞きたいという購入者とのニーズが一致した例と言えます。

近年はオフィスの場でも見られるようになってきました。集中するためにイヤホンをして、余計な情報を入らないようにしている方や、オンライン会議の場などではマイク側に雑音抑制をすることで、余計なノイズを除去し、快適にやり取りすることができます。ボタン1つで瞬時に防音と集音機能を切り替える機能がついていたりと、小型ながら高性能なものが増えており、作業効率の向上につながることでしょう。

話者推定

音声認識の仕組みの項目で、音響分析により一度人の声を音素に分解するというお話をしました。その際に声の周波数や音の強弱を細かく解析しています。

このことを利用して開発されたのが話者推定です。

当然、人の声には個人差があり、それぞれ周波数や声のトーンが違います。男性であれば声は低く、女性であれば声は高いのは一般的ですが、そこからさらに細かく解析することで男性同士の会話の中でも細かな違いを見つけることで、違う男性が会話しているということを認識できるのです。

従来の音声認識では、大人数の会話では会話内容を音声データとして認識することは可能でしたが、誰がどの発言をしたかはわからず、議事録としては不十分だったのです。人の声は一人一人違い、声紋と呼ばれています。大人数が会話する音声データの中でも違いを解析することで、今は誰が話しているのかを見極め、時間軸も記録することで、「○時○分に今○○さんが発言している」といった詳細なデータが取れるようになりました。

また、声紋は声認証のような生体認証システムにも使われています。一度自身の声を記録させれば、同じ言葉・同じフレーズでも反応しないといった使い方も可能になっており、様々な分野への応用が期待されています。

他社の機能について

音声認識は、一般的に人間の会話を一瞬で理解してテキストとして出力されるものと思われてきました。これだけ聞くと、テープ起こしや議事録のような使い方しか思い浮かばない方も多いのではないでしょうか?

確かに、逐一手書きや手入力していた議事録が会話と同時進行に記録されるのは非常に便利ですが、Siri、Googleのように、AIスピーカーなどの登場で、新たな可能性が広がっています。

他社はどのように音声認識を活用しているのか、簡単にご紹介させていただきます。

医療現場

音声認識は医療現場で電子カルテとして活用されています。

スピードが必要な医療現場において、患者様との問診で同時に電子カルテが作成されれば、カルテの作成時間の短縮に繋がり、患者様と医療スタッフ側の負担が軽くなります。

また、直接の会話が難しい場面では、声を吹き込んで入力された文字でコミュニケーションを図るチャットツールとしても活用できます。直接の接触を嫌がる昨今の状況を鑑みると、こういった新たなコミュニケーションの手段が増えていくかもしれません。

イヤホン、マイク

雑音抑制でご紹介したように、補聴器やイヤホン、マイクなどにも音声認識は活用されています。

雑音の抑制は集音機能の向上にもつながり、音楽の現場やオフィスでも活躍しています。AIの導入で補聴器の性能を各段に向上させただけでなく、ノイズキャンセリングイヤホンは若者を中心に大ヒット商品となりました。

テレワークやオンライン化に伴い、パソコンに備え付けのマイクでは不満という声もあがっており、マイクの機能や音の品質にも注目されますので今後も需要は伸びていくでしょう。

音声認識を用いたDX化

人間が言葉でやり取りしている内容を文字に起こすことができれば、データとして残ります。すなわちDXにつながるのです。音声認識を用いたDX化について具体的な例を挙げて解説していきます。

DXの詳細な説明は下記リンクよりご確認ください。

>> DXとは?定義や意味を分かりやすく解説!

議事録

従来の議事録では、会議の録音を人力によって文字起こしする方法、あるいは会議中に人がその場で文字に起こす方法が取られていました。人力による文字起こしは人手が必要かつ膨大な時間がかかります。外注などを頼むと、その分コストがかかり情報漏えいの危険性も出てきます。

しかし音声認識とAIを組み合わせれば人間の力を全く使うこと無く、スピーディに議事録が取れてしまうのです。DXの推進の要である、作業の自動化、効率化に加え安全性も確立しながら情報を蓄積することが出来るようになるのです。

クリスタルメソッドの音声認識機能

音声認識の概要や仕組みなどを解説したところで、弊社クリスタルメソッドがどういった取り組みをし、どのような成果を出しているかを簡単にご紹介させていただきます。

動画プレーヤー

こちらは、クリスタルメソッドの音声認識エンジンです。他社のエンジンと比べ、より正確に、リアルタイムで認識することが可能となっています。会議での議事録用などにご利用頂けると便利です。

弊社はAIを専門にしておりますが、その中でも「AI×音」にも強いこだわりを持っております。音に関しても、人の声、雑踏音、風の音、機械音、と様々な音が存在します。

音とAIの関わりを研究していく中で

・音の抽出

・異音判定

これらをテーマに日夜研究をしております。

音の抽出

上記でもご紹介した音響分析に該当するところですが、弊社は特に精度にこだわっております。

様々な音が混じりあった音の中から特定の音のみを抽出することで、大人数の中から話者推定するだけでなく、多くの音が複雑に絡む音の音源分離も可能です。

例として、バンドの演奏曲から楽器とボーカルの音に分離することができる、大人数の会話の中から特定の人物の声だけとそれ以外の声に分離する、などです。

※実際のサンプル音声もございます。

人の耳では個人差や誤差が発生するところをAIで判別することによって一定の精度で効率良くおこなうことができます。特に多くの音が溢れている都会や工場などでその真価を発揮致します。

異音判定

数々の弊社の実績の中でも特に高い評価を得ているのが異音判定です。

工場などの様々な音が飛び交う中でも正確に音を抽出・判別していきます。

命に関わる工場での制作過程において、人間の耳では熟練者でも難しい微妙な異音が判別可能になり、その精度は現在99%を記録しております。特に環境や材質に左右されることなく、常に高精度で判別し続けることが可能ですので、製造業や工場などで特に活躍しています。

製品作業や検品作業のみならず、機械自体の摩耗・消耗にもいち早く気付くことが可能ですので、製品やお客様・従業員の方々の命を守る意味でも非常に意味のある機能となっております。

クリスタルメソッドの音声認識機能は様々なところで役に立っている

ここまでで音声認識の歴史や仕組み、弊社クリスタルメソッドの音声認識への取り組みなどについて解説してきました。

音という抽象的な概念ですが、人間の五感に関する部分であり非常に重要なものです。音は様々な情報が含まれており、正確に音を読み取ることができればこれまでの課題の解決や新たな挑戦ができると考えています。

そのため音とAIを組み合わせたテーマに、弊社クリスタルメソッドは今後も挑戦し続けていきます。

[関連記事]

この記事で名前が上がった機械学習について詳しく知りたい方は下記の記事を参照して見て下さい。

>> 機械学習とは?概要やアルゴリズムを詳しく解説!

弊社公式Twitter: Twitter https://twitter.com/crystal_hal3

弊社公式Facebook: https://www.facebook.com/クリスタルメソッド株式会社-100971778872865/

Study about AI

AIについて学ぶ

-

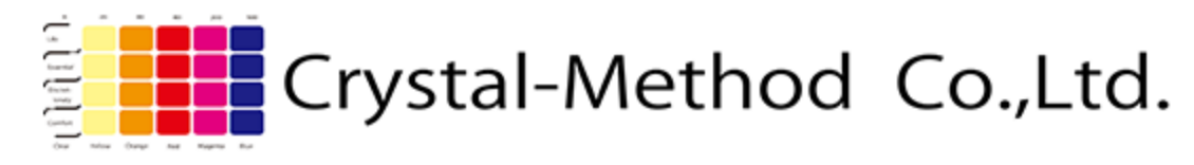

対話AI完全ガイド|医療・接客・教育まで網羅的に解説【2026】

対話AIとは、人と自然言語で双方向にやり取りするAIシステムの総称で、2026年現在は音声認識・大規模言語モデル(LLM)・音声合成・映像理解を統合した「マルチ...

-

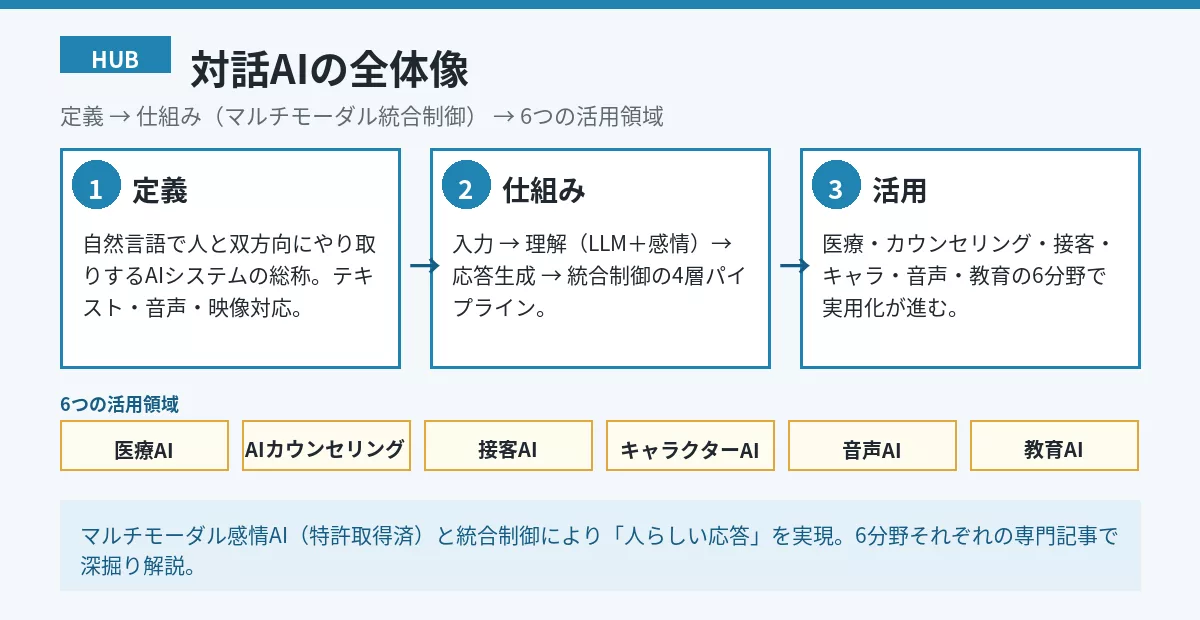

AI読み上げ無料ツール7選|自然な声の選び方と活用術【2026】

AI読み上げ無料ツールを選ぶときは「自然さ」「商用利用可否」「日本語品質」「API有無」の4軸で評価するのが、用途を問わず外さない選定基準です。本記事では、現役...

-

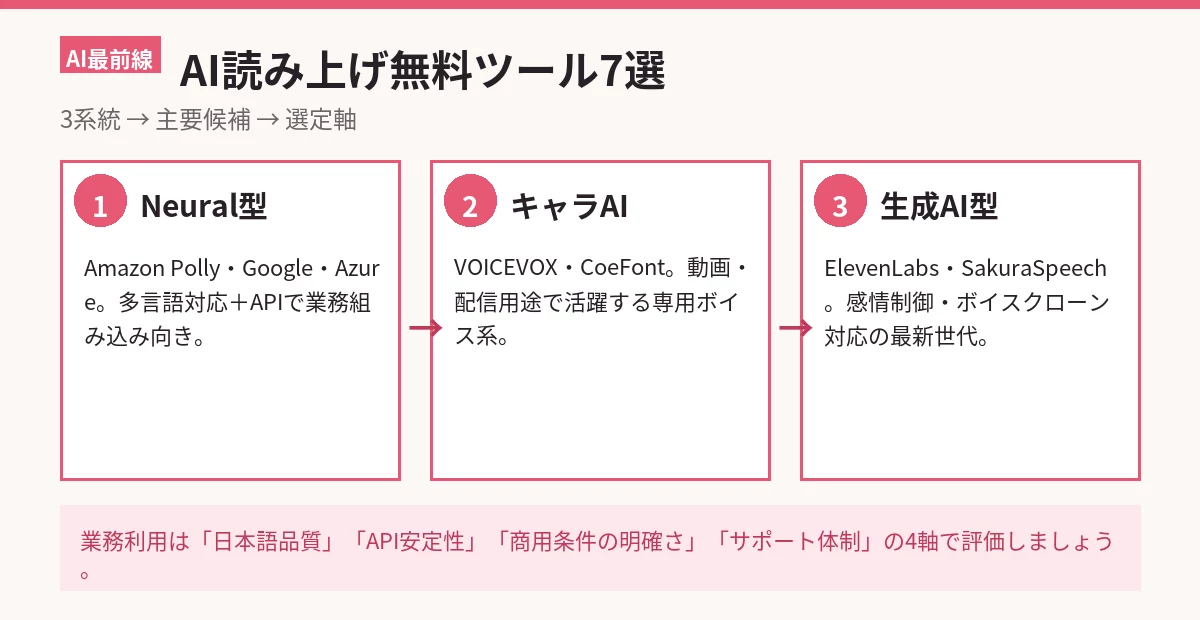

英語読み上げ無料サイト6選|発音学習に使える厳選ツール

英語の読み上げ無料サイトを選ぶときは「アクセント切替」「速度調整」「単語ハイライト」の3機能を備えたものを優先するのが、発音学習に最も効きます。本記事では、現役...