blog

AIブログ

クラスタリングとは | 分析の手法などをわかりやすく解説!

クラスタリングとは、教師なし学習と呼ばれる機械学習の一つで、類似性に基づきデータをグループ分けする手法のこと。元々は機械学習以外で使われていたこともあり、クラスタ分析と呼ばれることもあります。

↓機械学習についての更に詳しいことが知りたい方はコチラの記事を見て下さい!

【入門】機械学習とは?種類やアルゴリズムを簡単に解説!

Pythonによる機械学習

この記事では、AIを専門に研究開発している会社の視点から

・クラスタリングの概要

・クラスタリングの特徴

・クラスタリングの手法

について、わかりやすく解説していきます。

クラスタリングとは

機械学習には、大きく分けて教師あり学習と教師なし学習の二つがあり、クラスタリングは教師無し学習に含まれる学習方法になります。

まず、教師なし学習とは何かというと、データに存在する未知のデータを見つけるために、学習する時に正解を与えない学習方法のこと。正解と不正解が明確に存在する問題に対して有効的な教師あり学習と違い、教師なし学習は現実問題に関してはあまり適していません。その代わりに、新しい市場を開拓するときなどに適しています。

そして、その教師なし学習に含まれるクラスタリングとは、与えられたデータに特徴を見出しクラスタと呼ばれるグループに分ける方法のこと。与えられるデータは様々で、顧客や企業・地域・質問項目を分類したりすることで、セグメンテーションなどに用いられます。

[関連記事]機械学習と深層学習(ディープラーニング)の違いはこちら↓

分類との違い

データをグループ分けするというと、よく混同されるのが分類。この二つがどの様に違うかというと、クラスタリングは教師なし学習なのに対して、分類は教師あり学習に当てはまること。つまり、分類は既にあるデータを参考に、予測して正解を導き出すのに対して、クラスタリングは明確な答えというものを持ちません。

クラスタリングはグループ分けすることに目的があるのではなく、グループ分けすることで新たな市場を開拓することに目的があるため、その点において分類との違いがあります。

階層クラスタリングと非階層クラスタリング

そしてクラスタリングには、階層クラスタリング・非階層クラスタリングの2種類があります。

階層クラスタリングとは、例えば魚のネタを種類に上げたとき、赤身・白身と大きく二つに分けても、赤身の中にはマグロ・サーモン・カツオなどがあり、またマグロの中には大トロ・中トロなどと、樹形図の様にだんだん細かくなっていくグルーピングのことを指します。メリットとしては、グルーピングの過程が分かりやすく、サンプル数が少ないものに対して有効です。

対して非階層クラスタリングとは、階層クラスタリングの様に樹形図を作らず、最初に決めた代表点・クラスタ数に合わせて、グルーピングを行うこと。メリットとしては、サンプル数が多くても使いやすいことにあります。その代わりに、クラスタ数を自分で決める必要があり、まだ最適なクラスタ数を計算する方法が存在しないことが難点にあります。

クラスタリングの手法を導入するメリットとデメリット

クラスタリングの手法を用いることで、どの様なメリットが得られるのでしょうか。デメリットと一緒にその大まかな内容についてご紹介していきます。

メリット

- 効果的にセグメンテーションが行える

- 差別化戦略や市場の空白を見つける

- アンケートを分析する

セグメンテーションとは、市場に存在する顧客を様々な観点からグループ分けすること。顧客をグループ分けすることで、開発した自社製品を適切な顧客にアプローチしたり、逆にグループ分けを参考に新たな製品開発に利用するなど、マーケティングにおいてセグメンテーションは重要な役割を持っています。そして、そのセグメンテーションにおいてクラスタリングは利用がされます。

また、今度はクラスタリングの対象を他社製品に向けることで、他社が開発している製品の特徴や偏りなども判別しやすくなります。他社製品との差別化を行うことは、顧客にあえて自社の製品を買ってもらうための理由につながるため、これもマーケティングにおいて大いに重要なポイントだと言えます。そして、その点において他社製品の偏りが見えることは差別化に繋がり、さらに空白地帯が見つかれば新しいマーケットを開拓することにもつながります。

また、市場調査や製品テストを行った時に得られた消費者によるアンケート結果は、一見してバラバラな意見が並んでいる様にも見えますが、これもクラスタリングを行うことで一定のパターンを見つけることにもつながります。

デメリット

マーケティングにおいて、様々なメリットを持つクラスタリングですが、同時にデータ量が増えれば増えるほど、膨大な計算が必要になるというデメリットも存在します。特に、非階層クラスタリングに比べて計算量の多い階層クラスタリングは、データ数が多いと結果の解釈が難しくなる可能性があります。

また、非階層クラスタリングは最初に自らクラスタ数を決めなければいけない関係から、これを初期値依存といい、安定した結果を得る事が難しくなります。

クラスタリングの手法・アルゴリズム

グループ分けを行う時、ユークリッド距離がキーワードとなります。距離の近いもの同士を同じグループとして分類するため、二つの点を用意した時の直線距離を利用します。それを踏まえた上で、クラスタリングの代表的な手法についてご紹介していきます。

群平均法

階層クラスタリングの一つ。二つのクラスタ間に含まれている、全ての点における距離の平均値をグルーピングの基準にします。最も近いものをグルーピングする単連結法と、最も遠い二つをグルーピングする完全連結法の中間のやり方にあたり、一つだけ大きく外れた値が存在しても、影響されにくいという強みを持ちます。

ウォード法(最小分散法)

階層クラスタリングの一つ。グループ内における点の分散が最小になるように、グルーピングを行います。また、群平均法と同じく外れた値に影響されずらく、円状のグループができやすい特徴があります。

k平均法

非階層クラスタリングの一つ。kとはグループ数のことを意味し、kに合わせてランダムにグルーピングを行ったのち、中心点を計算してから、各点は一番近くにある中心点に合わせて再度グルーピングが行われます。

ただ、このk平均法は最初ランダムにグルーピングを行う関係から、kの数に合わせて生まれたグループの中心点同士が近くなってしまい、再度行われるグルーピングがうまくいかない可能性があります。よって、その弱点を補うために、k-means++を導入し、各点から中心点までの距離を考慮して、新しい中心点を割り振る方法などがあります。

まとめ

今回は、機械学習における教師なし学習の一つ、クラスタリングについて紹介していきました。その中で、階層クラスタリングはグルーピングの過程がわかりやすいものの、計算量が多くなる事、非階層クラスタリングは自分でグループ数を決める必要があり、最適なグループ数を計算するのが難しいなどの難点があります。

その難点を踏まえた上で、クラスタリングは市場の調査やテストマーケティングなどに有用なので、ぜひ市場戦略を考える時に取り入れてみてはいかがでしょうか。

Twitter https://twitter.com/crystal_hal3

Facebook https://www.facebook.com/クリスタルメソッド株式会社-100971778872865/

Study about AI

AIについて学ぶ

-

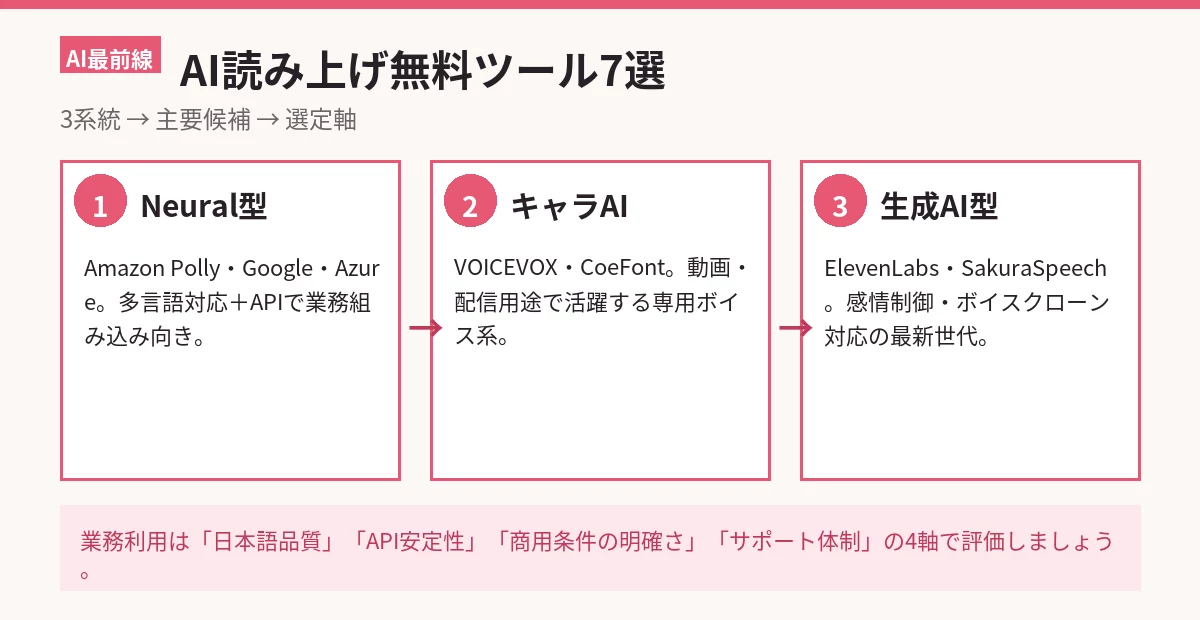

AI読み上げ無料ツール7選|自然な声の選び方と活用術【2026】

AI読み上げ無料ツールを選ぶときは「自然さ」「商用利用可否」「日本語品質」「API有無」の4軸で評価するのが、用途を問わず外さない選定基準です。本記事では、現役...

-

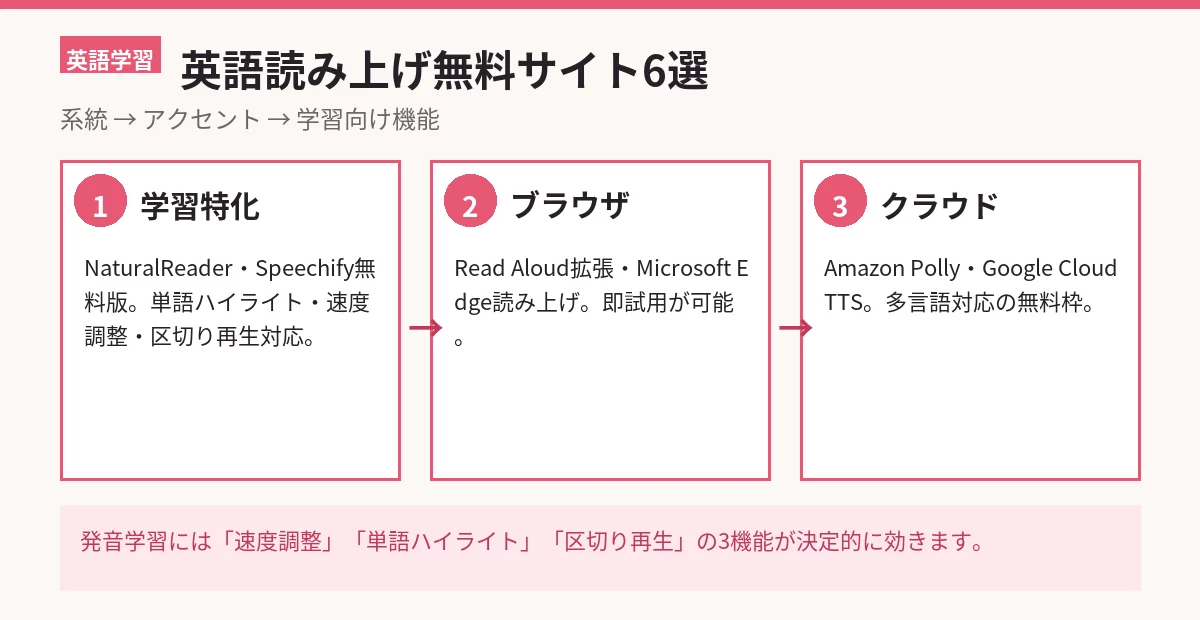

英語読み上げ無料サイト6選|発音学習に使える厳選ツール

英語の読み上げ無料サイトを選ぶときは「アクセント切替」「速度調整」「単語ハイライト」の3機能を備えたものを優先するのが、発音学習に最も効きます。本記事では、現役...

-

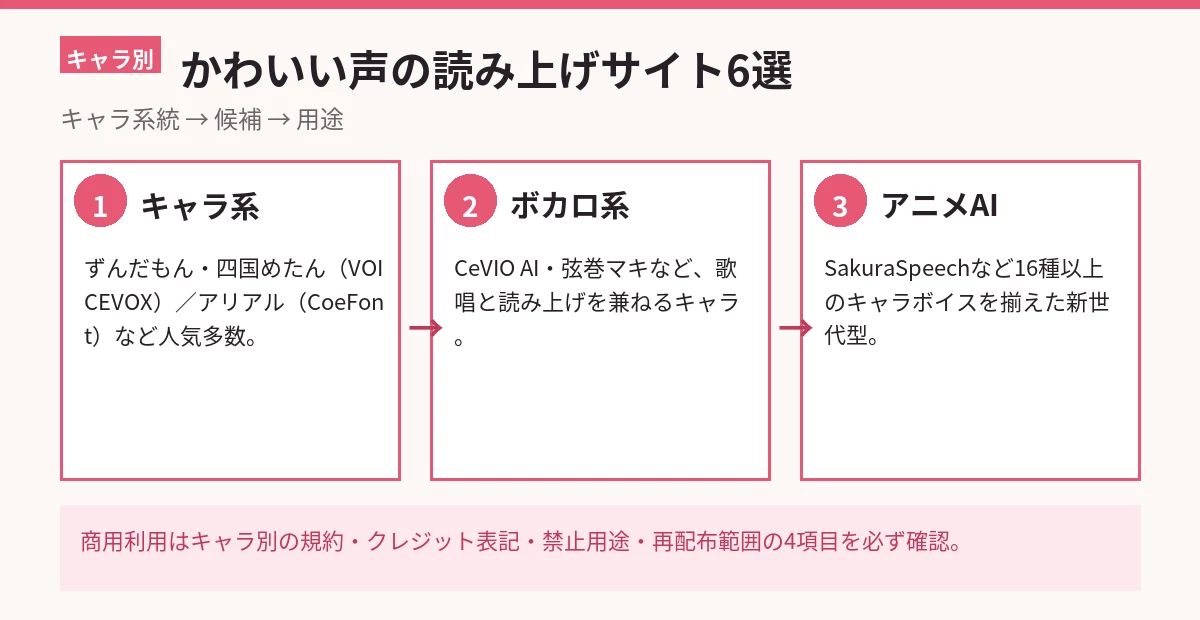

かわいい声の読み上げサイト6選|キャラ別比較ガイド【2026】

かわいい声の読み上げサイトを選ぶときは「キャラ系統」「商用利用条件」「声質の個性」の3軸で絞り込むのが正解です。本記事では、現役のAI音声合成エンジン開発者の目...